Ilya去哪了?

这个自去年年底OpenAI上演宫斗之后,所有关心AI的人都在问的问题,有了最终的答案。

Ilya Sutskever正式宣布了他创办的新公司:Safe Superintelligence Inc. (SSI),只有一个目标和一个产品:安全的超级智能。

SSI是一家纯研究机构,将通过在AI系统中嵌入工程突破来实现安全,而不是依赖临时加上的安全措施,近期没有销售AI产品或服务的打算。

Ilya曾多次在公开场合表示,他的主要工作是弄清楚如何让“超级智能”安全可控。换句话说,SSI的成立的目的,就是Ilya希望在没有OpenAI、谷歌和Anthropic等竞争对手所面临的干扰下继续他的工作。

安全的超级智能在某种程度上是对最初OpenAI“初心”的回归,OpenAI最初的目标也是开发安全且有益的人工智能,不受商业和竞争压力的干扰,确保AI技术的安全性和对人类的长期利益。

然而,随着时间的推移,OpenAI和其他公司在商业化和竞争压力下,不得不平衡安全与市场需求。Ilya以及OpenAI对齐团队成员的离开,核心原因也是OpenAI内部对安全的优先级产生了不可调和的分歧,通过 SSI,他试图通过自己的公司解决这些问题。

Daniel Gross在2018年参加YC的播客节目录制

新的联创,技术加强版Sam Altman?

SSI的另外两位联合创始人是Daniel Gross和Daniel Levy,Daniel Levy是Ilya在OpenAI的老下属,两人共同参与了多个重要的AI项目,他也是OpenAI优化团队的*,在GPT-4的架构和优化方面享有盛誉。

而Daniel Gross的经历则更具戏剧色彩,Gross 1991年出生于以色列耶路撒冷,热爱编程的他在家乡度过了人生的前十八年,本来打算入伍加入以色列国防军,但在一次前往旧金山的入伍前旅行中,他陷入了硅谷的创业热潮。2010年Gross被Y-Combinator录取,获得资助,当时他是YC有史以来最年轻的创始人,他也因逃避以色列国防军服役,再未返回以色列。

Gross随后推出了搜索引擎Greplin,后更名为 Cue。2013年Cue被苹果收购之后,Gross也加入苹果,领导人工智能工作。2017年Gross加入YC担任的合伙人,专注于人工智能,并创建了专门的“YC AI”计划。

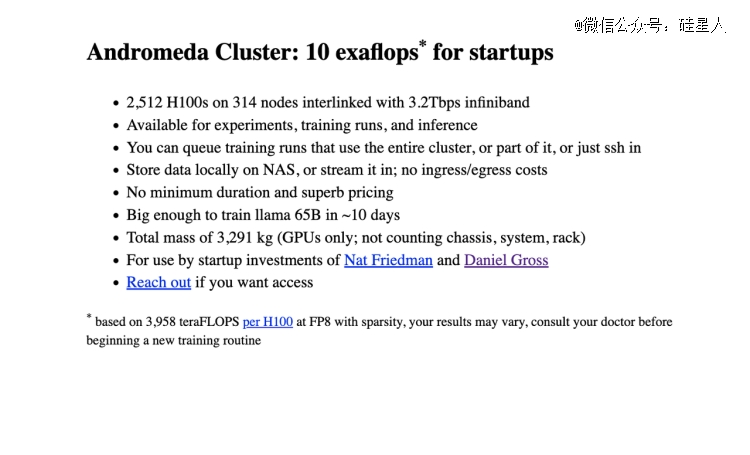

2021年,Daniel Gross与Github前CEO Nat Friedman成立了早期风险投资基金AI Grant。2023 年,AI Grant部署了自己的计算集群Andromeda,这是一个由 2512 个 H100 GPU 组成的超级计算机集群,供其投资组合中的初创公司使用。

Andromeda可以在约10天内完成Llama 65B模型的训练

作为投资人,Gross的投资组合可谓亮眼,他投资了Uber、Coinbase、Figma、GitHub、Airtable、Notion、CoreWeave、Character.ai、Perplexity.ai、Pika、Suno等公司。

Gross的投资组合显示了对科技行业整体发展趋势的全面理解,经常在具有颠覆性潜力的项目上下注。从投资选择看,Gross特别关注技术驱动的创新以及AI和软件领域,倾向于支持那些能够改变市场格局、具有高成长潜力的初创公司,特别是那些能够对人类日常生活和工作方式产生深远影响的创新解决方案的公司。

在这家新成立的公司中,Ilya担任的角色是首席科学家,负责革命性突破,而Gross在某种意义上替代了Altman的角色。

对比两人,我们也可以看到一些明显的共性和区别。Gross和Altman两人都“师出”Paul Graham,与YC颇有渊源,在技术创业和投资领域有丰富的经验,在硅谷拥有广泛的人际网络和资源,适合担当一家公司的头面人物。此外,相较于更加“长袖善舞”,跑遍全世界会见各地的立法者、监管者和投资人的Altman,Gross在气质上与Ilya更接近,两人都是技术天才型人物,他对技术的理解可能为公司在战略、技术方向和资源整合方面提供关键支持。Altman在OpenAI商业化上的野心路人皆知,而Gross与Ilya的合作关系可能更适合专注于AI的安全性和研究本身,Gross在商业与投融资方面的经验,也补足了Ilya的短板。

所以Gross的加入,有点像是Ilya离开OpenAI之后,找到了一位新的Sam Altman,只是不知道Altman内心会作何感想?

“Daniel Gross,别搞砸了”

这并不是OpenAI*次出现员工因为安全问题的分歧离去创办自己的AI公司。2021年,前OpenAI员工Dario和Daniela Amodei兄妹创办的Anthropic,也致力于比行业竞争对手更注重安全性,而Ilya的SSI看上去更加纯粹,也更具神秘感。

在AI行业中,有两大对立阵营:谨慎派和创新派。一方遵循硅谷“快速行动,打破常规”的伦理,称为“有效加速主义”,而另一方则希望确保所开发的技术足够安全,在实验室环境中经过充分测试,并在释放具有颠覆性的AI技术之前设置适当的防护措施,被称为“有效利他主义”。两方都希望AI技术的利益能够惠及全球所有人。

llya一直是人工智能领域的安全派,这一点和他的导师Geoffrey Hinton类似,Hinton从谷歌辞职,原因之一就是为了对AI安全提出警告,并且声称“对毕生工作感到后悔和恐惧”。近年来,llya的工作重点一直放在超级对齐上,去年llya在OpenAI内部创建了一个超级对齐团队,旨在确保未来的人工智能技术不会对人类造成伤害,他越来越担心AI可能变得危险,甚至可能毁灭人类,SSI的成立让他可以专注在避免这件事情的发生。

llya表示,虽然大型语言模型在人工智能领域占据主导地位,并将在SSI中扮演重要角色,但他们的目标是开发更强大的系统。他想追求的系统将具有更广泛的用途和能力,就像一个能够自主开发技术的巨大超级数据中心,所以必须要确保安全。

Safe Superintelligence Inc这个名字,听上去就像是来自以核战争后的末日世界为背景的《辐射》系列游戏,不仅是因为Ilya提到了SSI要追求的是“核安全”级别的安全,游戏中经常涉及的一个话题也是科技激进发展带来的潜在风险和道德困境。

这种使命感也与《辐射》中的公司相似,游戏中一家名为Vault-Tec的公司致力于保护人类在核战争中的生存,Safe Superintelligence Inc的名字也传达出一种明确的使命。正如在《辐射》中往往对公司背后的故事和目的披上一层神秘感一样,Safe Superintelligence Inc也给人留下广阔的想象空间。

Vault-Tec公司在游戏中以其建造避难所而著称,这些避难所表面上是为了保护人类免受核战争的毁灭,但实际上往往隐藏着更加阴暗的目的和实验。

即使是*有前瞻性和保护目的的科技企业,也可能因为内部实验、决策或外界环境的变化而产生意想不到的后果。SSI使命是否能真正实现,或者是否会在实际操作中偏离初衷,仍然值得关注。

这件事可能更多取决于Daniel Gross会不会成为又一个Sam Altman。