两周前,Sora现世,在AI领域又投下一颗重磅炸弹。演示视频中可以看到,Sora已经能生成含有多个角色进行特定运动的复杂场景。

OpenAI在技术报告中称:“Sora这类视频生成模型是世界的模拟器。Sora是能够理解和模拟现实世界模型的基础,我们相信这种能力将成为实现AGI的重要里程碑。”

也有人并不认同这种描述,Meta首席科学家Yann LeCun(杨立昆)认为:“仅根据文字提示生成逼真的视频,并不代表模型理解了物理世界。”

Sora为何会形成如此惊艳的效果?我们通过研究技术报告、访谈多位行业人士后发现,Sora背后虽然并非采用了多石破天惊的技术路线,但在视频模型技术路线尚未收敛的当前情况下,Sora达成的出色效果明显降低了其他市场参与者在技术路线上的试错成本,也在视频生成的设计逻辑等产品思路上提供了可借鉴的理念。

Sora会给行业带来怎样的剧变?接下来视频模型行业又将如何把握这次的挑战和机会?

“Sora给这个方向上的同行们指明了一条路,即Transformer也可以在视频模态下表现出很好的涌现能力。”线性资本投资副总裁白则人向36氪表示。

他认为,这会推动其他视频大模型公司加速研发节奏,迎来新的创业机会,开源技术在接下来也会取得进一步发展。

对于更多人而言,Sora解锁了对多模态视频大模型的新想象。OpenAI再次凭一己之力把多模态视频大模型推向了新的高度。在此之前,视频领域,受制于技术难度和数据集等难题,一直未出现类似ChatGPT、Midjourney这样的现象级产品。

Sora惊艳效果带来的启示:图片+视频混合训练

从产品细节来看,与其他同类模型相比,Sora生成的视频在时长、内容一致性、连贯性和分辨率方面表现出明显的优势。

Sora生成的视频,图源:OpenAI

从目前OpenAI发布的demo效果中可以看到,在生成的一分钟视频内,可以明显感觉到视频中的场景伴随镜头运动进行变化,并且保持内容一致性。

这是此前我们在使用Pika和Runway等视频模型产品时很难体验到的。比如,在《》中,我们发现Pika把静态的图片转化成一段动态视频之后,视频中的人脸出现变形,且比照片显示更虚一点。

视频生成能力相比文生图,技术难度更复杂。AI生成视频工具不仅需要掌握基础的自然语言理解能力,还需要在画面流畅度、风格准确性、稳定性、一致性、动作连贯性等方面有较好的表现。

Sora做到了其他产品都没实现的一分钟时长。而从技术实现来看,要想让一个模型生成的视频从4秒延长到10秒,背后涉及的技术问题就极为复杂。

其中,有一个重要的考量维度是视频生成逻辑问题:是image-to-video(图像到视频)路线,即先生成图像,再由图像生成视频;还是video-native(视频原声)的设计概念,即把图像和视频进行统一编码,混合训练。

“如果选择image-to-video(图像到视频)路线,用一帧一帧的图像去组成视频,比如先生成一个由32帧图像构成的一个4s视频,把这个视频最后一帧画面拿出来,作为下一个4s视频的起点。这种方式理论上可以,但是过程中误差会累计,且视频生成涉及到内容连续性问题,让问题变得更复杂。所以,最终第10s的画面会和初始视频相差甚远。”智象未来CTO姚霆表示。

Pika曾在一次采访中提到这种路线面临的挑战,“当视频很长时,确保每一帧都协调一致是个相当复杂的问题。在训练时,处理视频数据时要处理多张图片,如何将100帧图片传输到GPU上就是其中一个挑战。而在推理时,由于涉及到生成大量帧,推理速度相对于单张图片会更慢,计算成本也会增加。”

Sora采用了混合训练的方式。在技术报告中,OpenAI提到,采用将图片和视频混合训练的方式,用patch(视觉补丁)作为视频数据,来训练视频模型。

姚霆认为,OpenAI采用的这种video-native的设计理念,把图像作为单帧视频很自然地加入模型的训练,所以,Sora模型可以无缝切换为图像生成模型,这会促使技术人员去重新思考视频生成的设计逻辑。

他提到:“这也给了我们启发,从Sora效果中,我们看到,图像和视频的混合训练很重要,如果缺失了这一点,很难达到这样的高度。当然,这也证明OpenAI把技术架构之间耦合得很好。”

此外,对于Sora生成的视频中展示出的流畅运镜画面,也有人猜测,结合团队有专职数字内容的工作者来看,Sora在训练数据里包含了3D渲染数据,让它相比其他产品更擅长生成运镜画面,模拟出3D视觉效果。

这些都是Sora惊艳的效果背后的一些产品设计细节。

惊艳之余,另一个值得思考的问题是,虽然OpenAI把Sora称为世界的模拟器,但从目前的效果也可以看到其中的局限性。

“Sora未必真正的理解这个世界。”UCL计算机系教授汪军告诉36氪。

他举了一个例子,在现实的物理环境中,当一个玻璃瓶打碎时,会和其他物体的碰撞,这要符合物理规律现象。“如果Sora通过预测下一个token来生成视频,如何建立一个真正符合逻辑和物理规律的世界模型就会成为一个挑战,就像语言模型一样,有些模型可能只关注于生成人类可以理解的语言,但这并不意味着它们真正理解了物理逻辑。”

Sora的成功,是OpenAI暴力美学的再次胜利

OpenAI官网信息可以看到,Sora团队成立时间还未超过1年,核心团队共有15人,成员中甚至还有00后。

Sora为何能在这么短的时间内做到如此好的效果到现在都还是一团迷雾。这次Sora技术博客中,OpenAI也提到,不会分享技术细节,只提供了模型设计理念和demo视频,依照OpenAI越来越不Open的路子来看,未来我们也无法得知更多技术有效信息。

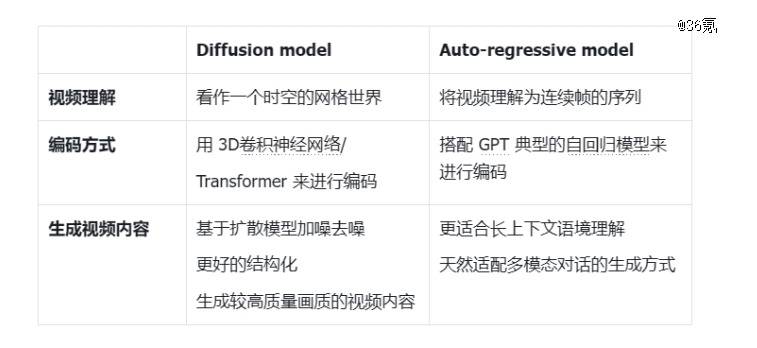

很多人都在探讨Sora的技术路线。目前,主流的视频模型框架有两种:Diffusion model(扩散模型)和Auto-regressive model(自回归模型),后者就是此前被很多人熟知的GPT模型。一直以来,视频生成模型的主流模型框架一直都未像语言模型一样收敛成一个确定性路线。

图片由智象未来CTO姚霆制作

智象未来CTO姚霆告诉36氪,两大路线的区别在于:“Diffusion model(扩散模型)基于扩散模型加噪去噪的机制可以更好地结构化,并生成较高质量画质的视频内容,而 Auto-regressive model(自回归模型)更适合长上下文语境理解,天然适配多模态对话的生成方式。”

在具体的技术实现中,两大路线之下也会继续衍生出不同的细分架构。比如,Diffusion模型路线之下,Gen-2、Pika就采用了U-net(卷积神经网络)架构,也有公司把U-net架构换成Transformer架构,采用DiT(Diffusion Transformer)架构。

Sora被认为就是采用了DiT的架构。这是目前市场的广泛猜测,主要依据是2023年Sora研发负责人之一Bill Peebles与纽约大学助理教授谢赛宁曾发表的DiT(扩散 Transformer)论文《Scalable Diffusion Models with Transformers》。

据36氪了解,国内的多模态视频模型创业公司爱诗科技在创立之初就选择了这条路线,而另一家创业公司HiDream智象未来也采用了DiT架构。姚霆称:“其实我们在图像生成模型上已经自研验证了一套成熟的DiT架构,相较于U-Net,DiT架构灵活度更高,且能增强图像、视频的生成质量。”

所以单从技术路线来看,Sora选择的技术架构并不是多稀缺的选择,只是早前各家视频模型公司考量不同,选择不同。

“技术路线Sora展示的信息中并没有很特别的东西。OpenAI肯定有自己独特的训练方法。”汪军告诉36氪。

他提到,“通过大规模的训练,使得能够利用海量的数据和计算资源,将工程方面做得非常出色,在我看来,算力和数据尚未到上限,还有进一步发展的空间,可以进一步挖掘数据潜力,在文本、图像甚至视频上进行更深入地处理,将模型能力提升至新的高度。”

所以,虽然没有进行底层技术路线创新,但OpenAI的强大之处在于,在这个路线上不断践行大算力、大数据的暴力美学——通过大力出奇迹的方式,依靠细致的工程化创新,推进模型涌现能力的持续优化。

OpenAI在报告中提到:我们的结果表明,扩展视频生成模型是构建物理世界通用模拟器的一条有前途的途径——“在相同的样本下,随着训练计算规模的增加,视频质量显著提高,也会表现出许多有趣的新兴功能,使Sora能够模拟现实世界中人、动物和环境的某些方面。”

此外,OpenAI也在论文中提到Sora也结合了GPT等产品能力。

姚霆认为,Sora强大建立在过去对DALL-E和GPT模型的研究之上。“Sora是OpenAI集成自己语言(GPT)、视觉理解(GPT4-V)和图像生成(DALL-E)多种能力的一个出口,它使用DALL·E 3的重述提示词技术,为视觉训练数据生成高度描述性的标注,因此能够更忠实地遵循用户的文本指令。”

目前,关于Sora参数量、训练数据的各种猜测甚嚣尘上,出入也很大,有人猜Sora的模型参数规模是百亿级别,训练成本是千万美元级别,也有人觉得参数规模可能只有3B,但数据标注成本不低,更有人认为Sora的推理算力需求是GPT-4的1000倍以上。

出门问问创始人李志飞称,Sora用的训练数据可能是数百万小时:“一般视频的分辨率超过128*128,最终的Tokens量应该至少是十万亿级别。如果Sora用了500万小时视频数据训练,那它使用的数据量大约相当于Youtube上9天的数据产出量。”

参数和数据量只是模型的其中一个方面,相比文本模型而言,视频模型的数据复杂度更高,维度更多,优质数据来源更少,数据标注难题更大,这些都是视频模型公司在具体模型训练中面临的工程化难题。

此刻,对于其他视频大模型公司而言,Sora惊艳的能力一方面验证了DiT架构,减少了在技术架构选择上的试错成本,能更快往前发展,另一方面,他们也需要面对更有挑战的现实难题——在没有OpenAI那样强大的人才和算力储备下,如何加强算法、数据等各个环节的工程化能力来追赶Sora。

国内视频模型公司如何把握机会?

Sora发布之后,有人悲观,认为:“Sora出现,其他视频公司都歇菜了”“国内外差距被进一步拉大”;也有人在剖析了更多细节之后认为视频模型的机会在被Sora激发之后,会迎来全新的发展空间。

一方面,Sora的技术路线有借鉴意义,能够让其他公司避免路线摇摆,加速进行产品,另一方面Sora带动市场更受关注之后,会吸引更多的人才、算力、数据、资金,迎来新的创业机会。

从Sora目前的进展可以看出,尚未实现实时更新,且等待视频生成的时间也比较漫长。这意味着,Sora尚未经受ChatGPT这样大规模用户的运行考验,其模型的计算资源和优化程度尚未达到理想状态,还需要时间进行继续迭代。这给其他公司留下了时间和空间。

据Reddit社区上的网友爆料,OpenAI在展示Sora功能时,主要使用了预先选择的示例,并未允许公众通过自定义提示词来生成视频,且生成一个1分钟的视频,Sora需要超过1个小时的渲染时间。

爱诗科技的创始人王长虎称,在他看来,目前Sora的技术发展相当于在GPT2和GPT3之间,还没到GPT4的水平,留给市场的空间很大。

线性资本投资副总裁白则人告诉36氪:“模型的发展会加速催生更繁荣的上层应用,带来更多的应用创新机会,这其中包括视频模型方向,也包括结合多模态的应用场景。但如何做出差异和建立长期护城河,是产品层创业公司一直面临的挑战,创业团队更需要关注模型之外的壁垒建立,更回归产品体验、应用场景和商业本质。”

市场进展方面,国内很多企业也早有布局。首先,大厂在视频领域的动作不断,基本上在推进语言模型业务的同时也布局了视频模型业务:

字节旗下剪映最近动作频频,目前,剪映已经在邀请一些博主内测旗下AI创作平台Dreamina的视频生成功能。

阿里通义实验室目前开发了开源视频生成模型和代码系列VGen。去年年底,阿里发布了最新AI应用:Animate Anyone,可以根据一张人物照片,生成人体动画视频。

百度在年初推出了一款视频生成模型UniVG,能够处理各种文本和图像的组合输入。

腾讯在2023年12月与北大和香港科技大学联合发布了视频生成模型AnimateZero,并在今年发布了一个可以提升视频质量的视频处理工具VideoCrafter2。

相比算力和人才储备的大厂,创业公司面临的挑战更大,但也并非没有机会。据36氪了解,目前智象未来HiDream.AI、爱诗科技、HeyGen、生数科技、右脑科技等创业公司,都已经预先布局视频大模型的业务。不同于上一波语言模型的国内国外各自地盘发展的情况,在视频模型领域,像爱诗科技等公司在早期就瞄准了海外市场,相当于与Sora在一个市场展开竞争。

有不少行业大佬已经入局。爱诗科技的创始人王长虎曾任字节跳动视觉技术负责人,主导了抖音和TikTok等产品,以及字节跳动视觉大模型从0到1的建设;智象未来HiDream.AI创始人梅涛曾是京东集团副总裁和微软研究院资深研究员;生数科技则由清华人工智能研究院副院长朱军教授带领,核心成员来自清华大学人工智能研究院。

所以综合目前国内视频模型公司进展来看,接下来,大厂和创业公司都会陆续加大投入,行业的竞争会进一步加剧。而大厂的优势在于,在人才、资金、算力上有原始积累,并且有数据和场景,而创业公司则可以利用自身快速敏捷的作战模式,加速模型和产品迭代,把握产品层的创新机会。

此外,在商业化路径上,由于Sora并未像ChatGPT一样开放公测,所以现在也无从看到清晰的商业模式,但从OpenAI释放的信号来看,可能依旧是以通用模型为核心。

但对于中国创业公司而言,在算力成本、数据训练等多重压力下,在商业化过程中也会较早面临路线选择。

未来,视频模型创业公司在不断发展之后也将出现不同的分野:一条是不断增强基础模型能力,打造C端产品路线,比如爱诗科技就选择了这条路,根据海外流量检测网站similarweb.com,目前爱诗海外产品PixVerse月访问量增长迅猛,已经超过百万;另一条是瞄准特定的场景进行训练,打造专门的视频模型,早日跑通某个B端场景的商业化闭环。

姚霆认为,视频生成赛道,对于创业公司而言,需要在早期就思考产品如何构建,从中寻找差异化的机会。“目前,视频生产还处于单镜头阶段,未来,如果要生产一个短视频或者短剧,视频生产流程需要考虑多镜头、分镜、故事逻辑等各类问题,这些产品问题都要前置考虑。”

技术、产品、商业化,每一处都内含成千上万个待解决的细节问题,2024年接下来的时间,对每一家视频大模型而言,都是一场硬仗。

【免责声明】:本文不构成任何投资建议。市场有风险,投资需谨慎。

如有任何疑问,请联系(editor@zero2ipo.com.cn)投资界处理。