据预印本平台bioRxiv12月底发布的一份预印报告显示,一篇由人工智能(AI)聊天机器人写出的研究论文摘要,甚至最终能骗过专家审核。这一报告一经发出就受到人们的广泛关注,研究人员对该AI机器人的影响力有着巨大争议。

聊天机器人ChatGPT的所有者是一家位于旧金山的软件公司OpenAI,该公司于11月30日发布了这款AI工具,并提供了免费试用。

ChatGPT可以根据用户的提示创建实际且智能的文本。它是一个“大型语言模型”,是一个基于神经网络的系统,通过消化大量现有的人类生成的文本来学习并执行任务。

上周,有消息称,美国科技巨头微软计划向OpenAI投资高达100亿美元,目前尚处于谈判阶段。

难以区分

自从它发布以来,由于该机器人的大部分输出内容就很难与人工书写出的文本进行区分,研究人员一直在努力解决围绕其使用的伦理问题。

现在,伊利诺斯州西北大学Catherine Gao领导的一个小组已经开展了一项研究:使用ChatGPT生成研究论文摘要,以测试科学家是否能发现它们。

研究人员要求ChatGPT根据发表在四大医学顶刊《美国医学会杂志》、《新英格兰医学杂志》、《英国医学杂志》、《柳叶刀》以及《自然》子刊《自然医学》上的精选文章,撰写50篇医学研究摘要。

随后该小组通过抄袭检测系统和人工智能输出检测器,将这些摘要与原始摘要混在一起匿名比较,要求一组医学研究人员找出由ChatGPT输出的摘要。

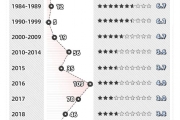

结果显示,ChatGPT生成的摘要顺利通过了抄袭检查:其原创性平均得分为100%,这表明没有检测到抄袭。人工智能输出检测器发现了66%的由ChatGPT生成的摘要。

而人工审阅者错误地将32%的生成摘要识别为原始摘要。

重大争议

Gao和他的同事在预印本报告中写道,ChatGPT确实写出了可信的科学摘要,不过使用大型语言模型来帮助科学方面的写作,其道德界限和可接受程度仍有待商榷。

英国牛津大学技术和监管领域学者Sandra Wachter不是此次研究的参与者,但是她对此表示非常担心。她补充道,“如果我们现在处于连专家都无法判断真假的情况下,那么我们就不会再看到那些能够在复杂话题中指导我们的论文摘要。”

Wachter提醒道,如果由ChatGPT生成的论文内容无法确定是否正确,那可能会有“可怕的后果”。这不光会给研究人员带来重大问题,因为他们阅读的研究是被捏造出来的;而且对整个社会也有影响,因为科学研究在社会中扮演着重要角色。

Wachter警告,更严重的或许导致基于研究的政策决定出现失误。

新泽西州普林斯顿大学的计算机科学家Arvind Narayanan认为,“任何严肃的科学家都不太可能使用ChatGPT来生成摘要。”

他补充道,“问题在于,该工具能否生成准确而令人信服的摘要。若是不能,那它的缺点是显著的。”

Narayanan还表态,此类问题的解决方案不在ChatGPT本身,而是应该集中在导致这种行为的不良动机上,例如招聘和晋升审查时只看论文的量、而不看质。

人工智能公司Hugging Face研究人员Irene Solaiman则认为,“这些AI模型是根据过去的信息进行训练的,而社会和科学的进步往往来自于与过去不同的思维,或开放思维。”

Solaiman补充说,在医学等关键领域,假信息可能危及人类的安全,所以一些期刊必须采取更严格的方法来验证信息的准确性。

该预印报告的研究小组建议,那些评估科学传播的人士应该制定政策,杜绝使用人工智能生成的文本。而要是机构选择允许在某些情况下使用该技术,他们应该就披露建立明确的规则。