一群人围坐在一间会议室里,他们的目光全部聚焦在大屏幕中播放的视频。

这其实是《每日经济新闻》再日常不过的一次内容审核会议。

但这一次的背后,却有一场较量在“暗流涌动”。

内容团队和往常一样,仔细地端详着灰度测试视频中主播播报的新闻。

但与此同时,同一屋檐下的技术团队同事,这一刻却在紧握双拳、捏着一把冷汗:

“千万不要发现任何端倪……”

没错,正是这样一段看似再正常不过的新闻播报,却成为了这场“较量”的根本所在——

因为视频里的主播N小黑,TA并不是个人,而是由AI技术合成的数字虚拟人。

当众人反应过来之后,这件事情在《每日经济新闻》内部迅速炸开了锅,后来甚至有人还问“视频里的哪部分是AI”?

技术团队给出的解释则是:

从表情到姿态,再到文字,全部都是。

而后来,这项技术更是悄悄地上线了70天,然而就连眼尖的观众们都没有发现异常。

当真相公之于众之际,结果可想而知,瞬间引发了大量的关注。

《每日经济新闻》更是把它置顶到了其官方微博之上,重视程度可见一斑。

而这一切背后的技术,正是来自小冰团队的小冰框架(Xiaoice Avatar Framework)。

但讲真,这还真不是小冰团队*次让虚拟人惊艳于公众面前。

你是不是个人,我已经感知不到了

小冰在打造N小黑的同时,其实还公布了另一个AI——N小白。

他俩在虚拟主播界的自然程度,可以说是*次提高到了与人类较为接近的程度。

从他们在视频的表现中不难看出,在播报新闻时的表情神态、嘴部变化,甚至是肢体动作的配合,都是具有一致性。

而且与N小黑一样,N小白也是在被“公之于众”前,连续70天、24小时不间断地做着新闻直播,也是没被发现的那种。

但也正如刚才提到的,N小黑和N小白只是小冰众多虚拟人中的一隅。

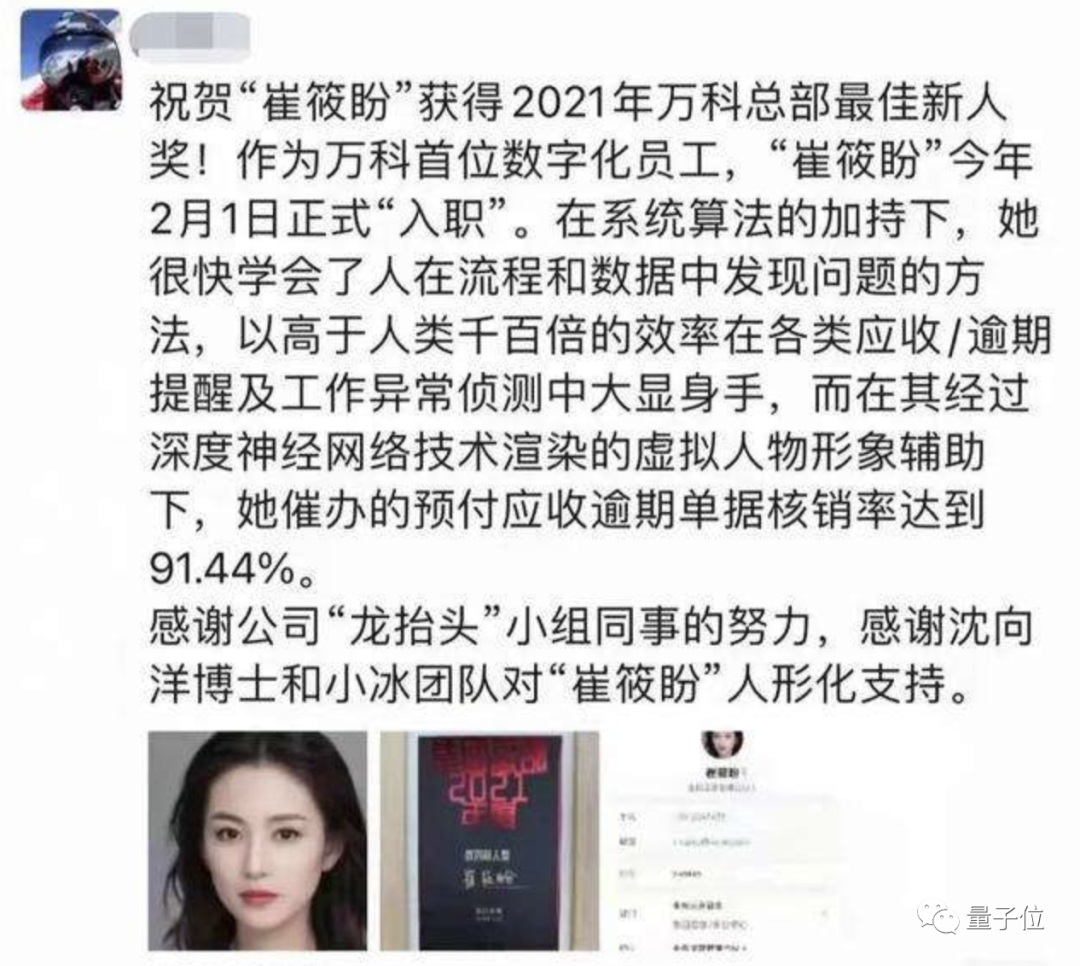

这不最近,一名叫做崔筱盼的万科员工获得总部优秀新人奖的消息,刷爆了朋友圈。

原因无他,因为崔筱盼也并不是个人,同样也是小冰框架下打造的虚拟人。

据介绍,崔筱盼其实早在2021年的2月份便入职万科,在职期间主要负责各种应收/逾期提醒及工作异常侦测相关工作。

在系统算法的加持下,她能够以惊人的速度学会人类在流程和数据中发现问题的方法。

她最终的工作成绩,便是人类效率的千百倍,更是在催办预付应收逾期单据核销率达到91.44%。

而且崔筱盼的形象也是成为此次爆火的原因之一。

很多网友对她的形象评价为“知性美”,更有甚者“傻傻分不清”她是真人形象还是AI创造出来的。

但比起逼真和美貌,崔筱盼形象上更独特的一点便是相由心生。

没错,小冰框架在创造她的形象时,并非是凭空而造,而是与她自身具备的业务能力相匹配的。

(也难怪崔筱盼会散发出职场女强人的气息了)

当然,除了上述的虚拟人之外,诸如操着一口浓郁方言的“山东大哥”:

从央美毕业、最近代表中国参加迪拜世博会的夏语冰,它们均是出自小冰框架之手:

……

不难看出,这些小冰创造出来的众多虚拟人,他们都具备各自的“看家本领”。

那么接下来的一个问题便是——

既能做到逼真,又富有多样性,还能批量工厂式生产,小冰是如何做到的?

像个人,并不容易

小冰现在做出来的虚拟人,无论是静态的照片,或者是动态的新闻主播,都可以说是真假难辨。

但讲真,尤其是在打造N小黑和N小白的时候,小冰团队最初也遇到了许多挑战。

因为在此之前,大家能够看到的所谓AI虚拟人主播还是比较假的。

例如主播的表情不够自然,下半身几乎不动,以及播报出来的语言也是带有“机械味”。

甚至《每日经济新闻》团队的成员都对此举打出了大大问号:

我们为什么要放上去这么假的虚拟人呢?

对此,小冰团队为了首次能够达到人类无法区分的程度,便在技术路线上做出了核心改变。

先从整体来看,小冰框架依然是核心。

而这一次的技术关键改变,在于对视觉上的优化。

以往我们在电影中能够看到的逼真效果,要么采用的是传统3D建模方法,要么就是CG后期渲染。

但这两种方法在时间周期和资金成本上的缺点也是非常明显。

基于这种现状,小冰团队便提出了一种新的方法——深度神经网络渲染技术(XNR)。

简单来说,这项技术主要包含三个步骤。

*步是构建两个专家模型。

*个是语音专家模型,基本的思路便是利用很大量的数据来学习、理解人类的语音。

例如人类在讲话讲到激动的时候,他的嘴型都会有比较明显的变化,而语音专家模型就是学会这项技能。

第二个是专家模型,则是通过采集摄像机等设备拍出来的人物视频数据,学习人类在说话过程中,嘴部的变化与眼睛、脸部其它肌肉之间如何产生微妙的联动变化。

如此一来,就能会让虚拟人在说话时,整个面部表情能够变得自然流畅。

第二步便来到了渲染的环节。

也就是将语音输入到深度神经网络渲染模型,而后会一帧一帧地渲染出自然的脸,并形成动态的过程。

但在这个过程中,前两个专家模型也会起到一个监督的作用,目的还是让整体效果能够自然。

第三步,则是一个自动化的过程。

也就是当把文字输入进来的时候,就会通过TTS(TextToSpeech)的方式,将文本变成语音。

而当机器接收到这些语音信号后,又会将其联动虚拟人的所有姿态、动作、表情等,最终生成一个完整的视频。

也正是在这种技术路线上的改变,最终才得以让小冰的虚拟人“瞒天过海”地骗过了人眼。

……

聊完了背后的技术,不少友友们肯定也要发问了:

做得这么像人,小冰要干什么?

我们还是拿N小黑/N小白的例子来看。

他们的效果一出来,便让《每日经济新闻》内容团队的态度,发生了三百六十度的改变——

从最开始的质疑和抵触,直接转变成了积极去接受。

他们后来直接主动拿着需求,找到小冰团队的技术人员说:

我们现在需要让AI来播报这些内容……

这是因为他们发现虚拟人播报新闻,原来不仅可以做得像人一样逼真,而且还能做到7 x 24小时不间断的那种。

如此一来,便让播报新闻这个本身就*时效性的事情,变得异常精准高效,还释放了大量的人力和物力。

甚至《每日经济新闻》的同行都会私下问他们:“你们什么时候变成24小时制了?”

……

而不仅仅是新闻主播这一件事,若是上升到更高的角度来观察,我们也不难发现AI虚拟人已然成为一种大趋势。

例如前一阵子在短视频平台一夜爆火的虚拟人柳夜熙,仅发布一条视频便受到了全民围观。

她做为一名虚拟人美妆博主,不仅是故事的精彩性,更是因为其高超的捏脸技术,让她呈现出了东方古典与现代时尚元素*结合的效果。

再如虚拟人AYAYI,仅凭一张“证件照”,在网络上瞬间爆红(当天便有224万浏览量)。

与以往虚拟形象不同的是,她拥有更加贴近人类的外貌,无论是肤质、发质亦或是微表情等,都做到了对真人的高度还原。

这是AI虚拟人,正在逐步迎合大众审美、口味的一种印证。

再从商业层面上来看,仅是2021年,虚拟人赛道上便有超过10笔的融资,嗅觉敏锐的VC们可谓是纷纷抛出了橄榄枝,着手布局。

除了这种视觉形象的虚拟人,在语音方面,Gartner预测到了 2023 年,员工与应用程序的互动中,将有 25% 是透过语音进行,但这一数值在2019年这个才不到 3%。

而这一切的背后的原因,表面上看是因为虚拟人技术不断迭代和发展。

但再深挖一层来看,还是其能够带来和创造的价值。

除了像虚拟主播能够释放人力和物力,像夏语冰所具备的绘画、创作能力,更是能够打破人类有限的创造力。

总而言之,站在现阶段来归纳虚拟人,或许有三大趋势,已经再明显不过:

虚拟人从长的逼真,到语音、姿态方方面面的逼真;

虚拟人从“骗得过一时”到也可以“骗得过一世”发展;

虚拟人已经从黑科技、秀肌肉等词语跳出,踏进各行各业。

而三大趋势汇集在一起,实际也在指向另一个更大的趋势——

虚拟人正在迎来质变的时刻。

如果说2021年“有虚拟人是新闻”,那么2022年,或许就是“哪个领域谁还没有虚拟人”了。

One More Thing

纵观小冰这几次虚拟人的亮相,背后规律实际也不难发现:

小冰总是“先做后说”,也就是让虚拟人先偷偷“上岗”,然后再悄悄拿结果惊艳所有人。

而小冰团队也透露,在已经公开“认领”的之外,现在还有一个虚拟人在人类中间“潜伏”已久。

很快,就又会带来一次恍然大明白。

所以小冰这究竟是对虚拟人技术极度自信?还是如此反复之后,让所有人对虚拟人“脱敏”,从而成功实现“AI和人类混居”?

你不妨也猜猜?感兴趣的人多了,我们找小冰团队求解去~

【免责声明】:本文不构成任何投资建议。市场有风险,投资需谨慎。

如有任何疑问,请联系(editor@zero2ipo.com.cn)投资界处理。