人工智能的虚火越烧越旺,有狂欢的地方必有人浑水摸鱼。很多初创公司普遍开始在自己的商业计划书中加入很多机器学习等的技术与说辞,并斩钉截铁地宣称他们是一家人工智能公司。尽管这些公司做的事情与人工智能毫无关系,但是在融资上却可能会有很大帮助。可以肯定的是,绝大部分在人工智能风口自我包装、搞到融资的公司,最后一定是不了了之,留下一地尸骨。

1

在好莱坞的科技大片中,人工智能总被定义为一种有自我意识的机器,威胁着未来的人类生存。在《西部世界》、《机器公敌》、《机械姬》、《星球大战》以及《超能查派》等知名科幻电影中,具备人工智能的机器人或计算机总是富有感情、具备意志力和决断力,能够以自我意识实施行动。比如,在《超能查派》的人工智能机器人“查派”就设定为一个自我觉醒的机器人。

在一系列机器人科技大片刺激中,人们对人工智能的想象与期盼也随之被激发出来。而在科技发展的现实中,我们也的确看到一些人工被机器取代的事实。

2000年时,高盛集团纽约总部的美国现金股票交易柜台有600名高薪的交易员。而今天只剩下两名交易员,因为自动交易程序逐渐取代了其他交易员的工作,这就是机器替代人力的现实场景。越来越多的公司开始布局无人工场、自动化交易。甚至很多人工智能专家开始幻想,有一天机器本身进行自我进化,进入所谓的“以人工智能开发人工智能”时代。

Google的AlphaGo不断挑战围棋高手的成功,“人工智能”这个词汇不再是科技人士口里的专有名词,而是全民在街头巷尾热议的话题。很多专家纷纷表示,世界上90%的工作十年后都会被人工智能所取代,这涉及到翻译、新闻记者、保安、司机、交易员等工作。这给人们在空中画了一个热气腾腾,看似味道鲜美的大饼。

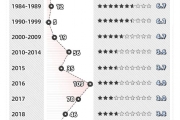

在万众垂涎三尺的热切期盼中,中国人工智能在近两三年中掀起了一阵阵高潮。根据投资界的统计,2017年中国人工智能领域公开的融资案例就已经超过150起,其中不乏寒武纪(A轮1亿美元)、旷视科技(C轮4.6亿美元)、商汤科技(B轮4.1亿美元+阿里15亿元投资)这样动辄上亿美元的大手笔。来自IT桔子的数据则显示,截止至2017年6月,我国创业投资机构共发生767项针对人工智能的投资案例,半年产生的融资已经超过150亿元,累积融资额攀升到635亿元,占据全球融资总额的33.18%。

尤其是从工业革命开始,经济增长的根本动力一直是技术创新。蒸汽机、电力、内燃机等通用技术的出现,的确催化了许许多多创新和机遇的浪潮。人工智能技术,必然也会总体朝着这个方向发展,但人们对AI也产生了许多不切实际的奢望。

瑞士神经学家Pascal Kaufmann认为,Google AlphaGo尽管在挑战成功人类所尊崇的、最苛刻的战略游戏围棋,但他坚持认为创造AlphaGo奇迹的并不是“真正的人工智能”,而仅仅是机器在游戏规则之内容制定策略的能力。AlphaGo并不能应用到实际的生活中,甚至在其他的游戏中,只是废物一个。

2

1950年,年仅23岁,后被人称为“人工智能之父”的马文·明斯基和他的同学埃德蒙一起,建造了世界上*台神经网络计算机。一些人把这个时间看做是人工智能的一个起点。

就在同一年,被称为“计算机之父”的阿兰·图灵在编写的《曼切斯特电子计算机程序员手册》一书中,提出了举世瞩目的“图灵测试”。与此同时,图灵还大胆预言了真正具备智能机器的可行性。

在图灵预测的带动下,当时很多学者心潮澎湃、激动不已,认为人工智能的时代马上就要来临了。有个别的学者甚至明确预测:二十年内,人工智能会做到人类能做到的一切。

6年之后的夏天,在达特茅斯大学举行了一次人工智能的头脑风暴会议。当时全球最显赫的专家们都聚集在一起,集中讨论如何解决智能模拟的问题,并宣称取得了一系列让人热血沸腾的成果。

在达特茅斯大学会议内容公布后,政府开始大手笔投资人工智能领域,迎来人工智能*个春天。在学术界,乐观的气氛弥漫滋长,在算法方面出现了很多世界级的发明,包括当前AlphaGo算法核心思想——增强学习的雏形(即贝尔曼公式)。

但终究乐观的情绪不抵现实的骨感。研究人员经过十几年的探索之后发现,实现人工智能是非常困难的,短时间内根本不可能的。于是在上世界60年代末,相关的基金开始撤资,人工智能迎来*个寒冬。

1973年,莱特希尔报告较为客观的评估了在当时的客观情况,并对智能思考的机器的可能性做出了消极预测。该报告使得该领域研究的幻想宣布坍塌,人工智能甚至成为整个时间段非常不光彩的事。

尽管在80年代,日本政府在支持人工智能发展方面热情高涨,这也迫使美国及英国政府感到了对抓不到前沿趋势的危机感,客观上支持了他们对人工智能的投入。但是这些并没有激起大面积政府和民间机构的新投资热情。

到80年代中期,随着苹果、IBM、微软等的崛起,人们发现之前所谓的初级人工智能还不如这些个人电脑强大。到1987年,人工智能的产物开始被很少人提及,这就是“第二次人工智能之冬”的开始。而且,当时的美国国防部高级研究计划局明确表明立场反对人工智能的探究和投资。

这两次人工智能的冬天都基于一个事实:人工智能的现实发展与人们的预期相差甚远,专家给予的乐观估计远远落后的现实,热情被消磨之后就是冬天。

这种情况直到1997年才发生逆转。这年,IBM开发的深蓝打败世界棋王,这才让人工智能重新回到人们的视野。之后,在二十多年的发展中尽管出现了很多人工智能领域的学术突破,但是直到2012年年末才真的被大众认识,人工智能开始迎来又一个春天。

到2016年3月,Google AlphaGo与围棋世界冠军、职业九段的李世石进行的围棋人机大战,世人皆知。此后,人工智能开始迎来狂欢。

3

有狂欢的地方必有人浑水摸鱼。

于是,很多初创公司开始在自己的商业计划书中加入很多关于机器学习、神经网络和其他形式的技术,宣称他们是一家人工智能公司。实际上,他们做的事情与这些技术基本上没有一点关系。

我前些天遇到一家做儿童书包的公司,他们宣称就是一家人工智能公司。结果了解下来,就是在书包里面放了一个可以定位的传感器。尽管这些公司做的事情与人工智能毫无关系,但是在融资上却可能会有很大帮助。

阿里巴巴的前CEO卫哲说:目前人工智能的泡沫巨大无比,媒体吹捧,市场过热。市面上很多公司号称自己是“人工智能”公司,但有九成的人工智能公司都是“伪人工智能”。

ReadMe公司的CEO格雷戈里·科贝格(Gregory Koberger)甚至在Twitter上告诉人们如何建立一个人工智能创业公司的两个步骤:*步是雇佣大量廉价劳动力假扮成假扮人类的AI,第二步就是等着AI被发明出来后,再模仿出来。他甚至认为,这种做法已经是业界周知的秘密了,只是大部分看客都还蒙在鼓里。

换句话说,一些创业公司所谓的人工智能,比如一些机器语音对话,背后不是“人工智能”,而是真正的“人工”;一些所谓的人工智能翻译,背后可能是很多人在翻字典。

早在2008年,一家号称能将语音留言转化为文字的Spinvox的公司,他们真实的工作就是海外电话中心的人工来完成的。据彭博社2016年的报道, X.ai和Clara公司员工每天都要花12小时假扮AI聊天机器人。2017年,业务支出管理应用Expensify承认,他们通过人工转写收据,而不像对外声称的那样用“智能扫描技术”。

在这场造假的游戏中,媒体与机构各有所求:媒体求得关注、吸引眼球,而公司或者机构则可以提升股票的价格,提升产品的销量,获得一轮又一轮的融资。

一旦人工智能的外衣被揭穿,对他们实际影响也不大,他们早就做好了跑路的准备,而中小投资者才是真正的买单者。可以肯定的是,绝大部分在人工智能风口自我包装、搞到融资的公司,最后一定是不了了之。

世界*黑客凯文·米特尼克(Kevin David Mitnick)在2017年8月参加中国互联网安全*峰会时,残忍的表示:“我还没有真正接触过真正符合人工智能的核心工具和技术,现在都还没有真正的人工智能产品,所有的AI都是假的。”

4

人工智能的概念满天飞,除了暗下以“人工”代替“人工智能”的造假,还有大量把数据分析当做人工智能的公司满天飞。这些公司一般的演变路径是:小数据分析公司——大数据公司——人工智能公司,实际上他们除了名称在演变外,实际上的工作几乎没有发生变化。

很多人错误地认为,一家公司的业务只要与数据有关,就可以被称为人工智能。其实区别人工智能公司和一般数据分析公司的关键在于:人工智能系统具有迭代性,分析的数据越多,系统就会变得越智能。比如,Google大力研发的自动驾驶系统是人工智能,因为它可以根据车辆在路上的行驶里程来不断完善自己。但如果只是根据数据来分析什么时候送外卖*,就不是人工智能。因为前者会迭代和自我学习,而后者不会。

一般而言,一个人工智能项目如果隔三个月去看,它在算法上的进步只是代数级,而不是几何级的,那么它更像是普通算法,就是伪人工智能。强的人工智能一定是进步神速,因为它本身会实现自我进化。

但实际上要实现这种自我进化,目前看起来还显得相当艰难,即使目前拿最火热的深度学习技术也让人看不到很明显的方向。2018年8月,在以“共享全球智慧,引领未来科技”为主题的世界科技创新论坛上,诺贝尔经济学奖获得者Thomas J. Sargent表示:当前的人工智能其实就是统计学,只不过用了一个很华丽的辞藻,好多的公式都非常老。

被誉为“硅谷精神布道师”的皮埃罗·斯加鲁菲(Piero Scaruffi)是全球人工智能及认知科学专家,他也认为:“人工智能*的问题是没有常识,人们已经花了几十年去尝试解决这个问题,可能我们的方法用错了。现在所有的重点都在深度学习,但深度学习不能获取常识。深度学习只是收集许许多多的数据,基本上做的是统计工作。”

5

当然,并不是所有的公司都只是打着人工智能的旗号,做着骗取资本的事情,而是实实在在在做一些推动人工智能发展的工作。但是,一些人工智能探索的方向仍然是值得警惕的。

比如,一些人工智能似乎走向了一个不是那么正确的方向:一味追求和人很像。如果真的很像了,又能怎么样呢?事实上,人越觉得轻而易举的事情,机器越觉得困难,比如走路,比如平衡感,比如情感。而人觉得越难的事情,机器觉得越简单,比如大型数据处理能力,记忆等等。所以,人工智能的方向也许应该是替代那些人觉得难的部分,而非替代人觉得容易的部分。

人工智能有两种应用形态:一种是弱人工智能,即只擅长单个领域,比如只会下围棋的AlphaGo;另一种是强人工智能,即各方面都很强。现阶段,弱人工智能比人强,强人工智能比人弱,且非常不成熟。

人工智能的好处,不是说他们比人聪明,而是他们的思维方式和人类不一样,因为人工智能的发展方向并不是强调它跟人类如何像,而是补充与增强人类智慧。人的思维方式只是具体的某一种思维方式,而世界上还有许多思维方式。凯文·凯利在此前的《科技想要什么》一书中,就把科技描述成生命的第七种存在方式,就像人类已经定义的六种生命形态,植物、动物、原生生物、真菌、原细菌、真细菌一样,科技也是一种具备自主进化能力的生命。

另外,人工智能要真正实现助推人类的发展,必须还要具有跟人类情感交互的能力,否则就永远是一件机器。人和人之间互动之所以有意义,是因为人类互动的百分之七八十都是情绪。

人和人之间之所以能够感受到相互的感情沟通和交流,是因为我们大脑有一组叫做镜像的神经元,它的作用就是当对方脸上出现或者快乐或者悲伤或者焦虑的各种表情的时候,你的脸上下意识的就会呈现出同样的表情跟他来呼应。人工智能尽管获得了一些发展,但是在解决情绪方面还有很大的差距。如果情绪问题没有进入人工智能底层,人工智能终究只是一个机器配置,无法获得人类的交互。

因此,人工智能需要情绪镜像的技术,用摄像头来捕捉人类的面部表情,再通过算法来理解人类的情绪,然后以情绪与人类进行交互。

6

人工智能一定是未来的方向,这点毋庸置疑。但是我们短时间,切记不可期望过高,否则可能又是一地的“尸骨”。

我们不要马上就期待看到路上不需要人工驾驶的汽车。其实,我们离那个时代还很远。坦率地讲,当前的人工智能领域就像是一杯摇晃很久的啤酒,既有真酒,更多是存在很大的泡沫。人工智能就像早期的互联网一样,成为了圈钱的金字招牌。

曾在IBM研究院和沃森团队工作了15年的Michelle Zhou把人工智能分为三个阶段:*个阶段是识别智能,更强大的计算机和更强大的算法,可以从大量文本中识别模式和主题;第二个阶段是认知智能机器超越模式识别,能够从数据中做出推论;第三个阶段是机器可以像人类一样思考和行动。

目前我们还处在*阶段,所有的人工智能都依赖人类提供数据,无论是计算机视觉还是语音识别都是如此。

至少到现在为止,很多宣称是人工智能的东西,也许叫做“机器自动”会更好。智能时代还远没有来临。

即使那一天来临,我们也要时刻警惕两点:一是因为个别机构或群体对人工智能的掌控,造成的整体社会权利的失衡。二是人工智能的暴力倾向。

英国哲学家罗素曾说:物理学中的基础概念是能量,而社会科学中的基础概念是权力,对社会动力学规律的阐释一定离不开权力。中世纪的社会活动家马基雅维利从当时残酷的社会现实出发,指出权力就其本质而言,与暴力、欺骗、残酷和战略侵犯密不可分,越能掌握这种工具的群体就会拥有越大的权力。一旦失去暴力、欺骗、残酷和战略侵犯等手段,就失去了权力存在的基础。

作为未来基础工具的人工智能,由于内核只可能被极少数的群体掌握,去影响人们生活的方方面面,因而会使人类之间已然失衡的权力变得更加失衡。

另外,随着人工智能技术的进步,未来可能一个普通人也具有了广泛制造暴力的能力。比如随着面部识别、无人机导航等开源技术的传播,使一些犯罪分子利用这些技术实施犯罪成为了可能。想象一下,如果一架自动飞行的无人机具备了面部识别能力,然后针对目标对象精准发动攻击,世界将会如何呢?

7

尽管人类离人工智能社会还很遥远,但是人工智能的发展还是带来了一些恐惧。2018年3月,Google被披露与军方合作,引起大量员工抗议,受到各路抨击。作为回应,Google CEO桑达尔 · 皮查伊(Sundar Pichai)在2018年6月宣布了他们使用人工智能的七项原则,以及四条底线。

这七项原则具体内容包括:①对社会有益;②避免制造或加剧社会偏见;③提前测试以保证安全;④由人类承担责任,即AI技术将受到适当的人类指导和控制;⑤保证隐私;⑥坚持科学的高标准;⑦从主要用途、技术独特性、规模等方面来权衡。

四条底线是:①对于那些将产生或者导致伤害的整体性技术,我们会确保其利大于弊,并将做好确保安全的相关限制;②不会将AI用于制造武器及其它将会对人类产生伤害的产品;③不会将AI用于收集或使用用户信息,以进行违反国际公认规范的监视;④不会将AI用于违反国际法和人权的技术开发。

这不应是Google一家公司的原则与底线,而是所有从事开发人工智能公司的原则与底线。只有这样,人工智能才是造福人类的工具,而不是毁灭自己的工具。